团队名称:智能监护及诊疗数据研究中心

中心简介:中心专注于面向特殊群体的智能监护和诊疗大数据分析,包括智能行为识别和情绪识别、病理特征挖掘和因果发现等。致力于推动机器视觉、人工智能和大数据分析技术服务智慧养老和康养监护。

研究包括:(1)智能监护平台开发。包括:①基于骨架和RGB图像的行为识别,如跌倒、求救、攻击、破坏等异常行为检测;②微表情识别和情绪分析,如专注、兴奋、平静、恐惧、痛苦、惊讶、厌恶、伤心、愤怒等;(2)诊疗大数据分析。聚焦于日常体测数据、癌症、罕见病、糖尿病和老年痴呆等诊疗数据的特征挖掘、因果推断何病情预测等研究。

研究成果

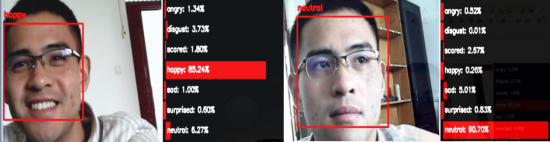

成果一:情绪识别原型系统

该情绪识别系统的核心模块是情绪识别模型。我们自主研发了基于深度学习的情绪识别模型。模型使用目标检测算法,能够锁定人的面部,然后使用卷积神经网络、池化层、全连接层以及SoftMax来构建Mini Xception情绪识别模型,并搭建了GUI人机交互界面,在实现情绪识别的同时,准确率和检测速度完全达到应用要求。模型可以识别出生气,恶心、害怕、开心、伤感、惊喜和自然七种情绪,我们在现实中进行了测试,如识别开心和自然情绪等,如图1所示。

图1情绪识别功能展示

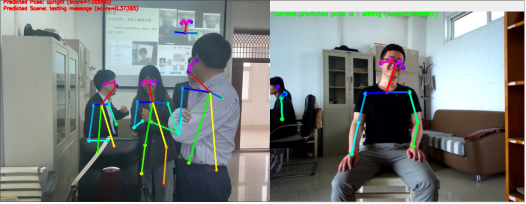

成果二:行为识别原型系统

系统面向老年人的异常行为进行实时监测,并将监测信息通过App和医护平台反馈给老人的家人及医务工作者,实现即时监护。系统利用摄像机捕捉图像,检测老年人的运动状态,识别老人行为。目前的行为识别主要是基于RGB图像,容易受到背景干扰。为了解决这一问题,我们使用Open Pose模型提取出人体骨架信息,将人身体在图像中提取出来,然后使用ResNet网络进行行为的特征提取,最后使用全连接层和SoftMax进行异常行为识别。

当前,我们研发的行为识别模型,已经可以在视频流中获取人体关键骨架关节点,并能够识别生活中的常见行为(包括异常行为),其中识别人站立行为和坐下行为的结果演示如图2所示为了获得最优性能的行为识别模型,我们密切关注行为识别研究的前沿动态,并提出了“基于空间推理和上下文感知注意力的人体骨架行为识别模型”,解决了目前使用骨架行为识别算法中存在的忽略骨架关节间结构相关关系的问题,并引入行为全局上下文注意力机制用于对每个视频帧的信息进行度量获得不同的关注度,撰写的论文已经被CCF B类国际会议ICME 2021录用为Oral Presentation论文,录用率仅为15%。

图2行为识别功能展示

成果三:向任意流数据的因果关系评估和推断模型

针对现有的因果特征选择算法无法直接处理动态特征空间或挖掘的因果特征不完备的问题,提出了基于近似马尔科夫毯(aMB)的在线特征选择算法OLaMB,在动态挖掘aMB的基础上,构建了面向流特征的局部因果结构学习算法LCSLSF,解决了对动态特征空间的适配性问题。模型已应用到肺癌数据中癌变特征的因果关系挖掘中,如图3所示。

图3肺癌病变特征因果结构学习

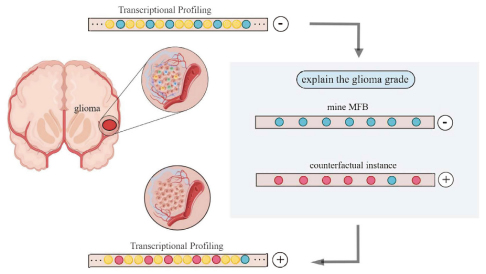

成果四:面向因果推断的反事实极小特征边界生成模型

提出了一种基于极小特征边界的反事实解释生成方法CEGMFB,以挖掘极小特征边界和生成反事实实例。模型实现了以最小代价生成相应的反事实实例。通过在克服无关和冗余特征的干扰下生成极小特征边界大大降低反转成本,使得虚假的因果解释和结果不稳定缺陷大大降低,。成果已经应用到面向胶质瘤病变的因果推断中,如图4所示。

图4胶质瘤病变特征挖掘和因果推断